Produit scalaire (dot product)

Le produit scalaire est une opération entre deux vecteurs qui associe un nombre à leur relation. C’est une façon de mesurer dans quelle mesure deux vecteurs pointent dans la même direction.

- Si les vecteurs pointent dans la même direction, le produit scalaire est grand et positif.

- S’ils sont orthogonaux (90°), le produit scalaire vaut 0.

- S’ils pointent dans des directions opposées, il est négatif.

👉 Intuition

Le produit scalaire mesure l’alignement entre deux vecteurs, clé en ML pour la similarité cosinus dans les systèmes de recommandation ou la recherche sémantique.

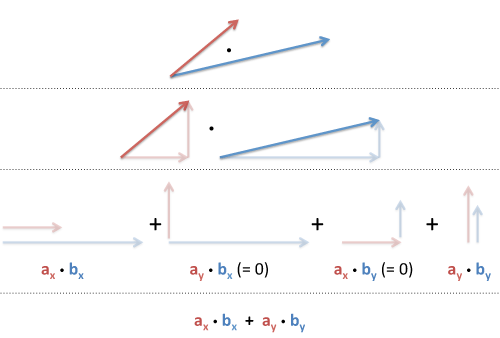

Définition mathématique

Le produit scalaire de deux vecteurs en dimension

📌

Ce résultat est un nombre réel (un scalaire), contrairement à l’addition de vecteurs qui donne un vecteur.

Exemple en 2D

Développement de la formule géométrique

Une autre définition relie le produit scalaire à l’angle entre deux vecteurs :

= longueur du vecteur . = longueur du vecteur . = angle entre et .

Le produit scalaire est grand si les vecteurs sont proches en direction, nul s’ils sont perpendiculaires, et négatif s’ils pointent en sens opposés.

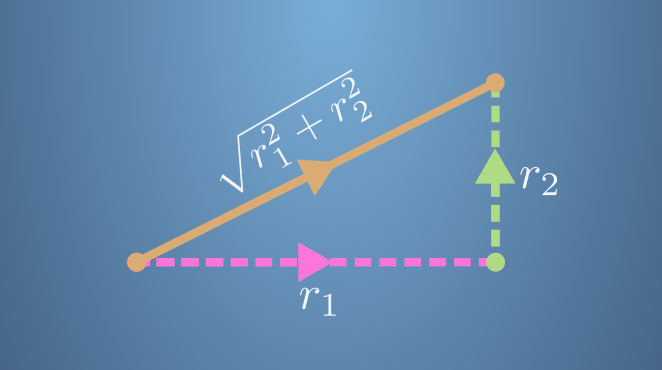

Dérivation à partir de la règle du cosinus

En géométrie, pour un triangle avec côtés

C’est la règle du cosinus, que l’on peut traduire en langage vectoriel.

Soit deux vecteurs

La norme au carré de ce vecteur est donc :

D’après la règle du cosinus :

On peut aussi développer directement avec le produit scalaire :

Développons :

Or :

. .

Donc :

En comparant avec la règle du cosinus :

On en déduit la relation fondamentale :

Interprétation géométrique

Le produit scalaire mesure l’alignement entre deux vecteurs.

Si

(même direction) : Produit scalaire positif et maximal.

Si

(vecteurs orthogonaux) : Vecteurs indépendants.

Si

(directions opposées) : Produit scalaire négatif.

Résumé visuel

- Produit scalaire > 0 : vecteurs dans la même direction.

- Produit scalaire = 0 : vecteurs orthogonaux (indépendants).

- Produit scalaire < 0 : vecteurs dans des directions opposées.

Propriétés fondamentales

Voici les principales propriétés du produit scalaire :

| Propriété | Formulation | Interprétation |

|---|---|---|

| Commutativité | L’ordre ne change rien. | |

| Linéarité (distributivité) | On peut “distribuer” le produit scalaire sur une somme. | |

| Homogénéité (associativité scalaire) | Un facteur scalaire sort du produit. | |

| Norme | Le produit scalaire d’un vecteur par lui-même donne le carré de sa longueur. |

INFO

En ML, ces propriétés sont essentielles pour les calculs efficaces dans les réseaux de neurones, où le produit scalaire apparaît dans les couches fully-connected.

Pourquoi c’est important en Machine Learning ?

- La norme d’un vecteur mesure la taille (ou importance) d’un paramètre, d’un poids ou d’une donnée, comme dans la régularisation L2 pour éviter le surapprentissage.

- Le produit scalaire permet de mesurer la similarité entre deux vecteurs, base de la similarité cosinus :

En IA, c’est central pour :

- Les systèmes de recommandation (e.g., Netflix utilise la similarité cosinus sur les embeddings d'utilisateurs et de films).

- La recherche sémantique (e.g., dans les moteurs comme Elasticsearch avec embeddings BERT).

- Le clustering (e.g., k-means utilise des distances basées sur normes).

- Les transformers (attention mechanism utilise des produits scalaires pour peser les relations entre tokens).

Exemple concret en ML

En NLP, deux embeddings de mots (e.g., "roi" et "reine") ont un produit scalaire élevé si similaires, permettant des analogies comme "roi - homme + femme ≈ reine".

En data science, la similarité cosinus compare des documents ou des images pour la détection de similarités.